本文来自量子位(大众号 ID:QbitAI),作者赖可

没错,美国人脸辨认体系独爱的是:白人中年男性。

其他非裔、亚裔族群,辨认率就没那么高了。

这周四,美国NIST发布的研讨陈述给出了这样的成果。

甚至在一些算法中,亚裔和非裔美国人被误认的或许性比白人高100倍。

关于一贯“政治正确”先行的美国,可想而知该成果带来的“爆炸性”。

还有一个风趣的成果,像来自商汤、旷世这样的亚洲算法,白种人和黄种人之间的误判距离就小一些。

美国官方组织威望检测

这项研讨由美国国家技能标准研讨院NIST进行,查看了人脸辨认软件在不同种族、性别、年纪上是否有差异。

研讨查看了由99家公司,学术组织和其他开发人员自愿提交的189种算法。包含了大多数业界抢先的体系,来自首要的技能公司和承包商,包含Idemia,英特尔,微软,松下,商汤和 Vigilant Solutions。

亚马逊没有提交查看,CNN Business从NIST处得知,亚马逊以为自己的软件和该检测不相容。亚马逊的人脸辨认软件Rekognition出售给了俄勒冈州警方,用于嫌疑人追寻。

量子位查阅这次提交查看的公司名单,发现没有谷歌

曾经有黑人兄弟发现了自己被谷歌的算法辨认成”大猩猩“,谷歌公司的整改办法是:把辨认类别中的”大猩猩“去掉了。(可戳量子位之前的文章:为了不把黑人兄弟认作大猩猩,谷歌的算法连真的大猩猩都不认识了)

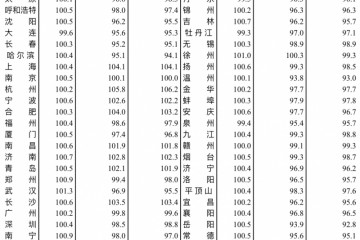

检测成果

1、在一对一匹配中,相较于白人,亚裔和非裔的人脸辨认过错率要高10到100倍。(不同算法不同)

2、在所有种族中,美洲原著民的假阳率最高;一对多匹配,非洲裔美国女人的假阳性率更高。

3、年纪和性别要素。晚年人和儿童更简单被辨认错,女人比男性简单被辨认错。中年白人准确率最高。

4、不同国家开发的算法体现不同。美国开发的算法中,亚裔、非裔和土著的过错率很高。亚洲开发的算法中,白人和亚洲人的过错率距离较小。

“成见”还有长尾影响

依据人脸辨认的运用场景和功用,检测分为一对一匹配和一对多匹配:

一对一匹配一般用于手机人脸解锁或护照查看。

一对多匹配用于确认某张相片是否在一个数据库中有匹配项,常常用于差人查找嫌疑人。

一对一匹配呈现过错或许会导致人脸无法解锁,给日子带来费事。可是一对多匹配的过错或许成果更严峻,就会让差人把无辜的人列入嫌疑名单。

这份陈述的首要作者Patrick Grother表明,

咱们研讨的大多数面部辨认算法中都存在人口统计学差异的依据。虽然咱们不探原因,但这些数据关于决策者、开发人员和最终用户在考虑这些算法的局限性和恰当运用方法时将是有价值的。

这不是第一份研讨显示出人脸辨认带有成见。

例如,上一年MIT实验室的一项研讨也得出了相似的成果。

凡遇到肤色较暗的人种以及女人,辨认的过错率就添加。

亚马逊等公司之前批评了这些研讨,称这些研讨运用了过期的算法,或者是体系运用不当。

在美国一些区域,关于人脸辨认已有禁令旧金山、奥克兰以及马萨诸塞州的两个城市萨默维尔和布鲁克莱恩,在本年已通过了制止公职人员运用面部辨认的条款。加利福尼亚州制止在警用摄像头中运用人脸辨认软件。

这次研讨成果,再次引起美国国会议员关于人脸辨认技能的监管评论。他们要求川普政府从头考虑扩展人脸辨认运用的方案。

美国俄勒冈州的参议员Ron Wyden在一份声明中说,

任何布置新技能的公司或政府有职责仔细查看其产品是不是真的存在成见和轻视,至少要在软件中完全查看是否有Bug。

网友评论:讲道德也要讲技能现状

有网友测验对”白人的正确率高“这一成果进行解说。或许是白人的面部特征差异(比方眼睛和头发的色彩)自身就比较大?

还有少量族裔的网友言传身教,讲了自己被“人脸辨认”唤醒“幼年伤口”的故事:

在机场的CLEAR体系常常辨认不出他,他不得不进入TSA Pre-Check。TSA查看需求触及布景和指纹查看。这让他从头阅历幼年时期朋友和教师认不出他的苦楚。

即便现在,当咖啡师看着他想不起来他的订单时,他依旧会体验到剧烈的心情。

现在他知道这不是他的问题,而是他身上原住民血缘的原因。

咱们日子在一个充溢成见的国际,而新技能的到来,会扩大实际国际的成见吗?

参考资料

https:///technology/2019/12/19/federal-study-/confirm/is-racial-bias-many-facial-recognition-systems-casts-doubt-their-expanding-use/

https://edition.cnn.com/2019/12/19/tech/facial-recognition-study-racial-bias/index.htmlhttp://gendershades.org/overview.html